Geri Yayılım Algoritması - Backpropagation

1. SİNİR AĞI NE DEMEK? (Basit Benzetme)

Beynimizi düşünelim:

-

Beynimizde milyarlarca sinir hücresi (nöron) var.

-

Bu nöronlar birbirine bağlı.

-

Yeni bir şey öğrendiğimizde (örneğin "elma" tanımayı), bu bağlantıların gücü değişiyor.

Yapay sinir ağı da aynı mantıkla çalışır:

-

Bilgisayarda oluşturulmuş yapay nöronlar var.

-

Bu nöronlar birbirine bağlı.

-

Her bağlantının bir ağırlık değeri var (bu, bağlantının ne kadar güçlü olduğunu gösterir).

-

Öğrenme demek, bu ağırlıkları doğru değerlere ayarlamak demek.

2. BASİT BİR ÖRNEK: Elma ile Muz Tanıma

Diyelim ki bilgisayara "elma" ile "muz"u ayırt etmeyi öğreteceğiz.

Elimizdeki veri:

-

Elma: Genelde kırmızı, yuvarlak

-

Muz: Genelde sarı, uzun

Sinir ağına 2 özellik giriyoruz:

-

Renk (kırmızılık derecesi: 0-1 arası)

-

Şekil (yuvarlaklık derecesi: 0-1 arası)

Ağın yapısı:

-

Giriş katmanı: 2 nöron (renk ve şekil)

-

Gizli katman: Birkaç nöron (ara işlemler yapar)

-

Çıkış katmanı: 1 nöron (0=elma, 1=muz desek mesela)

3. PEKİ BU AĞ NASIL ÖĞRENİYOR? (Geri Yayılım Mantığı)

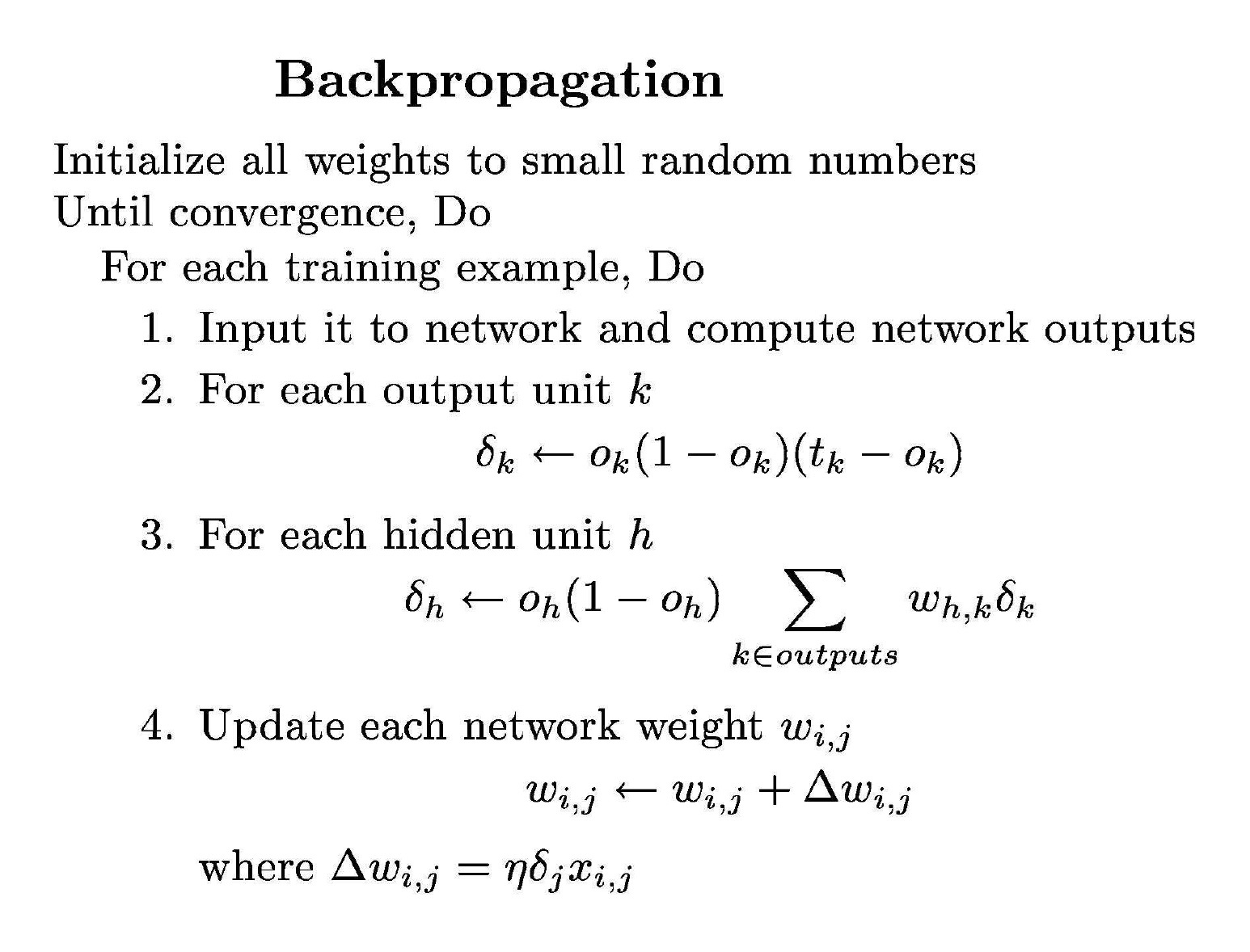

Şimdi Backpropagation'u çok basit bir dille anlatayım:

Adım 1: Tahmin Et (İleri Geçiş)

-

Bir elma resmi veriyoruz: Renk=kırmızı (0.9), Şekil=yuvarlak (0.8)

-

Ağ, elindeki rastgele ağırlıklarla bir tahmin yapıyor: "0.7" (yani %70 muz olabilir? gibi)

-

Halbuki doğru cevap "0" (elma).

Adım 2: Ne Kadar Yanıldığını Hesapla

-

Ağın verdiği cevap: 0.7

-

Olması gereken: 0

-

Hata = 0.7 - 0 = 0.7 (çok yanılmış!)

Adım 3: Kimin Suçu? (Geriye Yay)

-

Bu hatadan kim sorumlu?

-

Çıkış nöronu mu yanlış karar verdi?

-

Yoksa ona yanlış bilgi gönderen gizli nöronlar mı?

-

Ya da en baştaki giriş nöronları mı yanlış aktardı?

Backpropagation, hatayı sondan başa doğru dağıtarak her bağlantının (ağırlığın) ne kadar suçlu olduğunu hesaplar.

Adım 4: Ağırlıkları Düzelt

-

Suçu fazla olan bağlantıları zayıflat.

-

Doğru bilgi taşıyan bağlantıları güçlendir.

-

Bu düzeltme işlemi, görseldeki şu formülle yapılır:

Yeni ağırlık = Eski ağırlık + (Öğrenme hızı × Hata × Giriş değeri)

Adım 5: Tekrarla

-

Bunu binlerce elma ve muz resmi için tekrarla.

-

Her seferinde ağırlıklar biraz daha doğruya yaklaşır.

-

Sonunda ağ, elma ile muzu doğru ayırt etmeye başlar.

4. SOMUT ÖRNEK: Bir Ağırlık Nasıl Güncellenir ?

Diyelim ki:

-

Bir bağlantının ağırlığı: 0.5

-

Bu bağlantıdan geçen değer (giriş): 0.8

-

Hata miktarı: 0.2

-

Öğrenme hızı: 0.1

Değişim miktarı = 0.1 × 0.2 × 0.8 = 0.016

Yeni ağırlık = 0.5 + 0.016 = 0.516

Yani bağlantı biraz güçlendi. Doğru yönde ilerliyor.

5. NEDEN BU KADAR ÖNEMLİ ?

Bu basit mantık sayesinde:

-

Görsel tanıma: Kedileri, köpekleri, yüzleri tanıyan sistemler

-

Sesli asistanlar: Söylediklerini anlayan Siri, Alexa

-

Öneri sistemleri: Netflix'in sana film önermesi

-

Dil modelleri: ChatGPT gibi sohbet edebilen yapay zekalar

Hepsi aynı temel mantıkla çalışır:

"Tahmin et, hatayı bul, hatayı geriye yay, ağırlıkları güncelle, tekrar et."

| Terim | Basit Anlamı |

|---|---|

| Sinir ağı | Birbirine bağlı yapay nöronlardan oluşan öğrenen sistem |

| Ağırlık | İki nöron arasındaki bağlantının gücü (önemi) |

| İleri geçiş | Girdiyi al, işle, tahmin üret |

| Hata | Tahmin ile gerçek arasındaki fark |

| Geri yayılım | Hatayı başa doğru dağıtarak kimin ne kadar sorumlu olduğunu bulma |

| Ağırlık güncelleme | Hata payına göre bağlantıları güçlendirip zayıflatma |

| Öğrenme hızı | Ne kadar hızlı öğreneceğini belirleyen ayar |

19.02.2026